Erstellt von Axel Vent email:

Axel.Vent@t-online.de

Montag den 23. bis

Mittwoch den 25. Juli 2001.

Der Veranstaltungsort der

dreitägigen Akademie war die Folkwang-Hochschule in Essen-Werden

(Kammermusiksaal und Neue Aula), Klemensborn 39.

Anfahrtsplan unter:

<http://www.folkwang-hochschule.de/Wob/de/view/class189_id150.html>

Das Programm wurde

gemeinsam mit den Hochschulen:

Universität-Wuppertal

Folkwang-Hochschule

Essen,

Universität Essen

Fachhochschule

Nürnberg

Fachhochschule-Münster

Fachhochschule-Dortmund

Fachhochschule Düsseldorf

Fachhochschule-Aachen und

der

Kunsthochschule für

Medien Köln

ausgerichtet.

Für die Organisation und

Durchführung war Angela Wallenzus verantwortlich

(Tel. 02103-360581 oder

awallenzus@web.de).

VERANSTALTUNGSPROGRAMM

Thema der diesjährigen

Sommerakademie war:

PCI -

Performer Computer Interaction (Interface)

Montag der 23. Juli 2001

10.00 - 13.30 Uhr

Begrüßung durch Herrn Prof. Reith

Konzeptvorstellung der

bisherigen Akademien von Frau Angela

Wallenzus

Einführung in das Thema

Interaktion und Interface-Design durch Herrn Torsten

Stapelkamp

Moderation Torsten

Stapelkamp

Prof. Norbert Nowotsch

(FH Münster) (Rückblick

aktive Interfaces)

Prof. Klaus Gasteier (FH

Aachen) (Screenings)

Torsten Stapelkamp (Uni

Wuppertal) (Grundlagen

Interface)

Uwe Krägeloh

Axel Rösgen

Diskussion

14.30 - ca. 18.00 Uhr

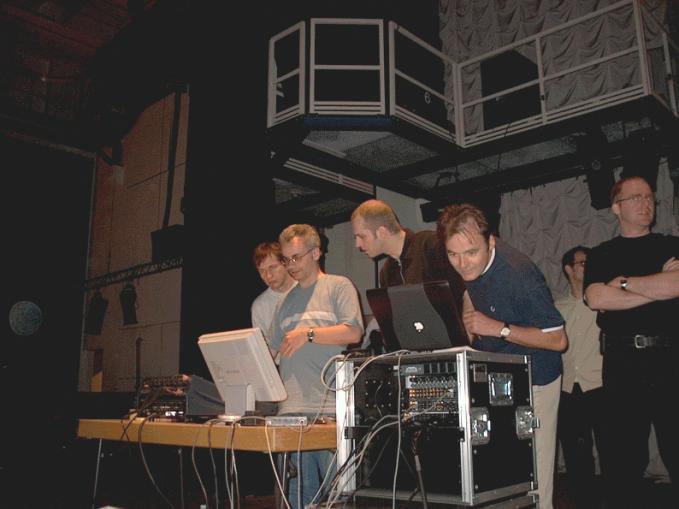

Frieder Weiß

(FH-Nürnberg) Palindrome

Performance System "Eyecon"

Demonstration und Workshop

Diskussion

Dienstag der

24.Juli

10.00 - 13.00

Prof. Dirk Reith

(Folkwang) (Live-Elektronik

in der Musik)

Prof. Dirk Reith /Thomas

Neuhaus (Anwendungsbeispiele und

Installationen)

Prof. Jörg Lensing (FH

Dortmund) (Aktuelle Problematik für

Performer)

14.00- ca. 18.00

Prof. Jörg Lensing,

Clemente Fernandez,

Thomas Neuhaus Theater der

Klänge Performance System

(Bewegungsgesteuerte

Sprachtransformation) -

"BigEye"

& "MAX/MSP", Demonstration & Workshop

Thomas Karstens (Uni

Köln) Die Gitarre - vom

konventionellen

Klangerzeuger zum Interface

(Demonstration)

Mittwoch der 25.Juli

Moderation Prof. Jörg

Lensing

10.00 - 13.00 Uhr

Prof. Jens Herder ( FH

Düsseldorf) (Räumlichen

Schallreproduktion für interaktive

Anwendungen)

Theis Müller

Stefan Landrock,

Karsten Blaschke (Uni

Essen) (Visualisierung von

elektronischer Musik

- realtime

motion processing)

Yunchul Kim (KHM) (Motion

Tracking mit Kamera, Interaktive realtime Audioinstallationen in der neuen

Aula)

Pause

14.30 - ca.18.00 Uhr

Jochen Viehoff (KHM) (Mensch-Maschine

Interaktion und Interface-Design, JAVA basierte Lern- und Ausbildungsplattform)

Prof. Oliver Wrede (FH

Aachen) (Interface-Design)

Prof. Reith Führung

durch durch die Gerätesammlung des ICEM

Ort: Südflügel, 3. Etage

Abschlußdiskussion der 3 Tage Sommerakademie

![]()

Beginn und

Eindrücke

1.Tag 23.07.01

Begrüßung der Teilnehmer und Referenten durch Frau Walenzus, Herrn Reith und dem Moderator des Tages Herrn Stapelkamp. Danach eine kurze Vorstellung der Studenten, Dozenten und Professoren und Frau Wallenzus.

![]()

Prof. Nowotsch – Rückblick aktive Interfaces

(FH Münster / Design)

Herr Prof . Nowotsch gibt einige verschiedene Beispiele der ersten interaktiven Kunst.

*Sogenannte multiples, z. B Schallplatten, bei denen man selbst schon als Zuhörer eingreifen konnte. Z.B konnte man bei einem Künstler 2 Schallplatten auf zwei Plattenspielern gleichzeitig abspielen und erhielt so eine andersartigere Komposition. Dies wurde vom Künstler bereits so angelegt.

*“Die tödliche Doris“ , Schallplattenkasten incl. einem dazugehörigen Mini-Abspielgerät, welches früher in Spielzeugpuppen eingebaut war. Die von den Künstlern angefertigten Schallproduktionen waren auf diesen kleinen dafür vorgesehenen Schallplatten gepresst und konnten auf dem kleinen Gerät abgespielt werden. Dazu ein Buch mit Texten.

In den 60er Jahren gab es bereits in der Fluxus- Szene einige interaktive Versuche:

Erich Reuch z.B. hatte elektronische Bilder bzw. Skulpturen, welche durch Sensoren durch Vorbeigehen Töne produzierte.

Jakov Agam 1967 : Ein Raum in dem eine Glühbirne hängt, wird je nach Lautstärke im Raum heller oder dunkler. Dies veranlasste die Zuschauer natürlich zu großem „Krach-Machen“!

Als einen der wichtigsten Vertreter der interaktiven Kunst wurde in diesem Zusammenhang auch Nam-June Paik genannt.

Hier mit TV- Oszilloskopenbilder, welche auf ein Mikrofon reagieren, sogenannte Audioscopes.

Hier kann man mit Magneten die Fernsehbilder beeinflussen..

ein link zu Nam June Paik:

http://www.artincontext.com/listings/pages/artist/f/0wy9rkpf/menu.htm

N.J. PAIK 1963: „Random Access“ : Bespielte Tonbänder waren auf einer Leinwand aufgeklebt. Der Zuschauer konnte nun mit einem mobilen Tonkopf, der an einem Verstärker angeschlossen war diese erkunden.

Der Künstler Todd Rundgreen http://www.tr-i.com/home.html entwickelte ein Computerprogramm- bzw. ließ es entwickeln mit dem Namen TIR I . Dieses Computerprogramm besaß eine Auswahloberfläche ohne Mauszeiger. Der Bediener konnte Musikstile, Artikulation, Tempo etc. selber einstellen und erhielt so seinen eigenen Soundtrack.

Eine ebenfalls interressante CD-Rom kam von Brian Eno und Robert Fripp mit dem NamenBraincandy. 3- dimensional mit 3 D- Brillen. Musik und visuelle Effekte konnten zusammengemischt werden.

Mediamatic (jetzt nur noch als Zeitschrift im Netz) brachte mehrere eigens für die Zeitschrift erstellte CD-ROM´s auf den Markt. Der Benutzer bewegt sich bei der Bedienung wie durch ein Labyrinth, wird verwirrt um dann ab und zu doch weitere Ereignisse auszulösen. Es wird hier also bewusste Verwirrung betrieben. Zum Beispiel gibt es Buttons in Form von miniaturisierten Kühe über welche man Klänge auslösen konnte.

Ein sehr wichtiger Künstler der interaktiven Kunst war schon sehr früh Myron M. Krüger . Eigentlich ein Computerwissenschaftler, der sogenannte „virtual-environments“ schuf.

Ein link zu seiner vita

http://prixars.aec.at/history/kunstler/mkrueger.html

Hier sieht man Bilder aus seiner Installation Videoplace.

Videoplace von Myron W. Krueger. 1984-1996. 1990 auf der `ars electronica´ präsentiert. Mit spezieller Soft- und Hardware. Man musste einen Raum betreten wobei eine Kamera dann die Menschen im Raum abgetastet hat und die Silhouetten und Bewegungen vom Computer in akustische (über Lautsprecher) und visuelle Elemente (auf einer Videoleinwand) umgesetzt wurden. Dies funktionierte technisch über Effekte und Delays bei der Videobearbeitung. Wenn man den Raum betrat, fing es an, wenn man rausging, hörte es auf ! Später gab es auch noch andere Installationen davon, auch Spiele, die man zu zweit spielen konnte. Oder man konnte auch kleine Videowesen einfangen und zerstören, indem man diese einkreiste und zerquetschte. (frühes Tamagotchi). Es gab davon verschiedene „Spiele“. So konnte man auch selbst auf der Videoleinwand zeichnen oder mit einem zweiten Menschen gemeinsam malen oder schreiben.

Fairlight baute zur gleichen Zeit außer einem Musiksynthesizer auch einen Videosynthesizer CVI (Computer Video Instrument) mit dem man in Echtzeit Videobilder manipulieren konnte. Sehr viele Eingriffsparameter sind durch sehr viele nach außen gelegte Bedienungselementewie Schieberegler, Taster und sogar einem Touch-Pad zugänglch und so ist echtes Live-Spiel möglich.

Einen anderen Ansatz zu einer solch bedienerfreundlichen Maschine lieferte ein Grafikcomputer einer belgischen Firma, bei dem auf einem riesigen Tisch alle Bedienelemente und Menues hardwaremäßig tatsächlich vorhanden waren.

![]()

Prof. Gasteier Screenings

(FH Aachen / Design)

„Präsentation beispielhafter Projekte (auch eigener), die sich mit der interaktiven Steuerung von Audio/Video durch einen oder mehrere Benutzer in einer Raumsituation beschäftigen, oder generell originelle/innovative Ansätze in der Beutzerschnittsstelle zu Audioanwendungen aufzeigen.“

SMILE

Es geht bei dem Programm um eine Patternpuzzlemaschine bei der einzelne Patterns einer nie erschienen Platte der Beach Boys selbst zusammengestellt werden können um sich so eine endlose Collage dieses „never-ending-songs“ zusammenzustellen. Das Interface besteht aus einer etwas psychadelic angehauchten Oberfläche, bei der man durch anklicken einzelner Karten bzw. Symbole eine andere Zusammenstellung der Abfolge bzw. der Kombination dieser Audiofragmente bekommt. Ein „front-ent zu einer Datenbank, ein Hypersong“

Bei dem Projekt „Kopffussresonator“ handelt es sich um ein Programm welches Techno-Beats spielerisch zusammenfügen kann. Hierbei gibt es eine graphische Oberfläche mit verschiebbaren Kugeln, welche dann die einzelnen Rhythmus repräsentieren und so wiederum die Gesamtkomposition beeinflussen.

Das Theremin wurde besprochen als ein elektronisches Instrument welches sich durch sein excellentes Interface auszeichnete und dies in einer Zeit in der es elektrotechnisch gesehen nur Röhren gab.

Link zum Theremin center in Moskau

http://postman.ru/~xmedia/theremin/

Dann wurden verschiedene Ausstellungsenvironments der KHM Köln gezeigt. Unter anderem ein Theremin aus Holz. Hierbei handelte es sich um einen begehbaren Raum in dem Hölzer von der Decke hingen. Je nachdem welchen man sich näherte wurde Sound erzeugt. Dann eine Spielinstallation. Es besteht aus einem großen Brettspiel auf dem sich Kugeln befinden. Je nach Lautstärke und, oder Frequenz, welche die Spieler ausstießen, konnten nun die Spieler die einzelnen Kugeln auf dem Spielbrett bewegen. In diesen Kugeln befand sich die Elektronik und Mechanik, welche auf diese verschiedenen Laute reagierte.

Dann noch ein eigenes Projekt von Herrn Prof. Gasteier bei dem eine Art elektronischer Spieltisch mit verschiedenen großen Knöpfen ausgestattet war. Von oben wurden nun verschiedene Videobilder auf diese Knöpfe projiziert. Betätigte man einen solchen Knopf, wurde dieses Bild in die, in der Mitte des Tisches projizierte Videoanimation aufgenommen und fand zusätzlich seinen Niederschlag in der Soundanimation.

Genannt wurde auch die „Bodymover“ Installation im Siemens Pavillon auf der EXPO in Hannover bei dem über eine Bewegungserkennung der Zuschauer Licht und Klangbeeinflussungen stattfanden

Torsten Stapelkamp – Grundlagen Interface

(Uni Wuppertal)

Interaktion und Interface, Vortrag zur Sommerakademie ´01

von Torsten

Stapelkamp, gehalten an der

Folkwang-Hochschule

Essen Werden am 23.07. - 05.07.01

Der Titel der

Sommerakademie lautete:

“PCI - Performer

Computer Interaction”

und spannt einen

Bogen von

- Grundlagen zu den

Themen: Interface und Interaktion über

- Beispiele von

klassischen Interfaces im Alltag bis hin zu

- aktuellen

Problematiken für Performer, die innerhalb von Installationen und/oder

Tanz-Szenen agieren und dabei Interfaces für Sprachsteuerungen und

Tracking-Systemsverwenden.

In meinem Vortrag

werde ich mich auf die Erläuterung der folgenden drei Begriffe konzentrieren

und deren Zusammenhänge darstellen:

- Interface

Design

- Screen Design

- Interaktivität

Grundsätzlich sind

sie eng miteinander verbunden.

Beginnen wir mit “Interaktivität”.

Interaktion das ist

zunächst einmal kein neuzeitlich technologischer Begriff, sondern hat seinen

Ursprung in der Soziologie und Psychologie. Er beschreibt die Wechselbeziehung,

einschließlich der Kommunikation, zwischen Individuen innerhalb einer Gruppe.

Wenn ich mich mit

jemandem unterhalte, ändert sich das Gegenüber gleichzeitig mit mir jede Seite

wird etwas erfahrener. Das würde zunächst bedeuten, daß eine Interaktion mit Maschinen

nicht möglich wäre. Die Maschine ändert sich nicht, während dem ich sie

bediene. Sie gibt mir lediglich die Auswahlmöglichkeiten, die ihr zuvor

einprogrammiert wurden. Jede Überlegung zu interaktiven Medien muß genau

genommen mit dem Satz enden: “Es gibt (noch) keine Interaktion mit Maschinen”.

Den Begriff der

Interaktivität sollten wir hier in der Diskussion aber möglichst weit fassen.

Wenn man dem Begriff

des “Offenen Kunstwerkes” nach Umberto Eco folgt, müssen nämlich nicht beide

Seiten einer Interaktion tatsächlich aktiv sein.

Die

"plastischen Massen des Barock [werden] niemals die Feststellung eines

bevorzugten, frontalen, definiten Standpunktes gestatten, von dem aus sie zu

betrachten wären, sondern den Betrachter ständigdazu veranlassen, den Standort

zu wechseln, um das Werk unter immer neuen Aspekten zu sehen, so als ob es in

ständiger Umwandlung begriffen wäre" (Eco, Offenes Kunstwerk).(gezeigten

Beispiele, abweichend vom Barock: Palazzo Spada; Anamorphosen: Andrea Pozzo,

Gemächer des. hl. Ignatius, Rom, 1688; Portrait Prinz Edward VI., 1546)

Die Malerei des

Mittelalters konnte verschiedenartig entschlüsselt werden: Wörtlich,

allegorisch, und moralisch. "Bei jeder Rezeption kann ein Werk durch das

mentale Mitwirken des Betrachters in einer originellen Perspektive neu

aufleben" (Eco, Offenes Kunstwerk, S.116).

Zusätzlich zur

Intention des Künstlers bringt der Rezipient seine Vorlieben und Vorurteile

ein, seine Bildung, seine Subjektivität und schafft damit quasi

"automatisch" eine eigene Perspektive (Beispiele: - Arnolfini

Hochzeit, Jan van Eyck, 1434; Las Meninas, Velazquez, 1656).

Diese Tendenzen des

“Offenen Kunstwerkes” gibt es auch in der Musik. z.B. bei Stockhausen und Cage.

Cage z.B. erarbeitet

in seinen Kompositionen eine komplexe und nichtlineare Struktur. Diese Art des

Vorgehens verweist auf die Idee der "Interaktivität".

Die Werke von

Stockhausen und Cage eröffnen den Zuhörern ein Möglichkeitsfeld. Die Werke von

Cage sind darauf angelegt, sich in einem ständigen Wandel zu befinden, der den

Zuhörern zahlreiche Interpretationen und neue Sichtweisen anbieten. (Peter

Kiefer von der KHM gab weitere Erläuterungen.)

Zwei wichtige Punkte

hat die Interaktivität für Künstler interessant gemacht:

a) Vermeidung der

Hierarchisierung und

b) Herausforderung

zur Kommunikation.

Als eines der

frühesten interaktiven Werke könnte man Max Ernsts Axt werten. Die Besucher der

“Zweiten Dada-Ausstellung” 1920 in Köln sind ausdrücklich dazu aufgefordert,

die Axt zu benutzen, wenn ihnen eine Arbeit nicht gefällt.

Ein weiteres

Paradebeispiele dürfte "Participation TV I" (1969) sein, von Nam June

Paik. Das Werk entsteht, indem es vom Rezipienten manipuliert wird. Die von

einem Mikrophon übertragenen Geräusche, werden auf dem Bildschirm abstrahiert

dargestellt.

Interface

Ein Interface ist

die Symbolisierung einer Funktionalität. Um Interface zu erläutern, ist es

nicht erforderlich einen Computer zu beschreiben. Interfaces befanden sich

schon immer in unserer Umgebung. Ob man ein Interfaces überhaupt versteht,

hängt jedoch davon ab, wie man konditioniert wurde. Ein Interface zu

betrachten, heißt letzten Endes sich zu erinnern. Wenn ich die Funktion z.B.

einer Heftzwecke nicht kenne, erkenne ich auch nicht ihr Interface.

Demnach hat man erst

dann ein wirklich ideales Interface geschaffen, wenn es ohne Erinnerung bedient

werden kann, somit auch kulturübergreifend funktioniert. Die

Informationssysteme auf Flughäfen und U-Bahnen zeugen von solchen Versuchen.

Diese Funktion der

Erinnerungsspeicherung kann aber auch umgekehrt genutzt und angelernt

werden.

- Interfaces gab es bereits im

Mittelalter und natürlich

auch davor. In seinen Predikten

nutzte der Mönch

Berthold von Regensburg (1210 - 1272)

die

Hand als biologisches Interface Zur

Erinnerung der

Bibelgeschichte. Jede Fingerkuppe

steht für ein Kapitel.

- In die Gesichter der Zuhörer zu

schauen, heißt in

Interfaces zu blicken (Zustimmung,

Ablehnung, etc).

- Die Lasche zum Öffnen an der Milchtüte.

- Der Fahrkartenautomat, den ich nie

verstehe:

Hardware-, Software-Interface.

- Einen MP3 Player als reine Hardware

oder reine

Software. In beiden Fällen haben wir

es mit den

selben Interfaces zu tun.

- Webdesign und CD-ROM Produktionen bestehen

ausschließlich aus Screendesign mit

mehr oder weniger

guten

Interfaces.

Im Gegensatz zum

Screendesign muß ein Interface

- objektiv

verifizierbar sein

- es wird am

Kriterium “Bedienbarkeit” ("Usability") gemessen.

Gutes

Interfaces => Sicherheit und

Spaß am Produkt Schlechtes Interface => Frust und Ablehnung.

Screendesign hingegen gilt als Illustration vorgegebener

Konzepte. Eine Aussage von Prof. Gui Bonsiepe (FH Köln), die nicht ausreichend

beschreibt, welche Möglichkeiten in einem gut gestalteten Screendesign stecken

können. Nicht selten dient das Screendesign nur der Plakatierung sprich der

Etikettierung eines Interfaces, was zumindest bei der Tastatur eines Telefones

vollkommen ausreichend ist (Schriftart, Größe und Farbe der Zahlen, etc.). Was

deutlich machen sollte, daß ein Screendesign im Gegensatz zum Interface auch

dann noch seinen Zweck erfüllt, wenn das Resultat einer austauschbaren,

subjektiv geschmäcklerischen Entscheidung entspringt. Im Internet finden man

zahlreiche Beispiele dieser Art. Dort dient ein Screendesign nicht selten

ausschließlich dazu, die gewünschte Zielgruppe anzusprechen. Die Bedienbarkeit

sprich das Interface wird dann nicht selten das Opfer des Screendesign. In

einer Zeit, in der die “Neuen Medien” noch neu waren, resultierten daraus

zwangsläufig die beiden Fraktionen der Interfacedesigner und der

Screendesigner. Erstere entwickelten interaktive Produktionen, die von der

Bedienbarkeit her überzeugten aber nicht selten den Scharm einer Packung

Schlaftabletten hatten. Letztere realisierten Produktionen, die zwar

interessant gestaltet aber von der Bedienbarkeit höchst abenteuerlich waren.Der

Idealfall wird demnach dann erreicht, wenn das Screendesign mehr ist als nur

die optische Fläche, die über ein Interface gelegt wird.Prof. Klaus Gasteier

sprach in diesem Zusammenhang von Poweruser-Interface und vom Interface, um

Unmotivierte zu motivieren.

Allgemeine Literatur zum Thema:

Screendesign/

Interface/ Interaktion

Gui Bonsiepe:

Interface. Design neu begreifen. Mannheim: Bollmann 1996

Bernhard Bürdek

(1991): "Design. Geschichte, Theorie und Praxis der

Produktgestaltung", DuMont, Köln spricht über Interface-Design als neuer

Aufgabe des Designers

Stuart K. Card, Jock D. Mackinlay, Ben Shneiderman

(eds.): Readings in information visualization. Using vision to think. San

Mateo, CA: Morgan Kaufmann 1999

Richard Coyne: Designing information technology in the

postmodern age. Cambridge MA: MIT Press 1995

Dieter Daniels, Über

Interaktivität, http://www.hgb-leipzig.de/ theorie/interact.htm, 1996, Leipzig

Umberto Eco, Die

Poetik des offenen Kunstwerkes, in Im Labyrinth der Vernunft, hrsg. von M.

Franz und S. Richter, Reclam, Leipzig, 1995

Pelle Ehn, Lore

Malmborg: The design challenge. Scand. J. Inform. Syst. 10, 1&2 (1998)

211-218

formdiskurs.

Zeitschrift für Design und Theorie. Themenhefte “Zwischen Form und formlos. Zur

Not und den Grenzen von Gestaltung” Nr. 1 (I/1996); “Design und Neue Medien”

Nr. 2(I/1997); “Neue Technologien – neue Konventionen?” Nr. 6 (I/1999)

David Gelernter:

Machine beauty. Elegance and the heart of technology. New York: Basic

Books 1999

Interact!, Hrsg.

Wilhelm Lehmbruck Museum Duisburg, Cantz Verlag, 1997

Brenda Laurel (ed.): The art of human-computer interface

design. Reading, MA: Addison-Wesley 1990

Marshall McLuhan,

Die Gutenberggalaxis

Marshall McLuhan,

Die magischen Kanäle - Understanding Media, Verlag der Kunst, Dresden, 1995

(Erstveröffentlichung 1964)

Media, Kunst,

Aktion, Hrsg. Goethe Institut und ZKM, Springer-Verlag, Wien, 1997; CD-ROM

Kevin Mullet, Darrell Sano: Designing visual

interfaces. Communi-cation oriented techniques. Mountain View, CA: SunSoft

Press 1995

Frieder Nake: Work. Computers. Design. Scand. J. Inform. Syst. 10, 1&2 (1998) 53-59

William M. Newman, Michael G. Lamming: Interactive

system design. Reading, MA: Addison-Wesley 1995

Donald A. Norman: The invisible computer. Cambridge, MA:

MIT Press 1998

Donald A. Norman

(1989): "Dinge des Alltags. Gutes Design und Psychologie für

Gebrauchsgegenstände". Campus,

Frankfurt. Hier werden Design-Prinzipien formuliert ohne Bezug auf

Design-Schulen.

Florian Rötzer

(Hrsg.), Digitaler Schein - Ästhetik der elektronischen Medien, Suhrkamp,

Frankfurt a.M., 1991

Scandinavian Journal of Information Systems, Vol. 10,

1 & 2 (1998) (erschienen 1999)

Edward R. Tufte: Visual explanations. Images and

quantities, evidence and narrative. Cheshire, CT: Graphics Press 1997

Mark Steffik (1996)

macht in "Internet Dreams. Archetypes, Myths, and Metaphors", MIT

Press, Cambridge, MA ... deutlich, dass die Entwicklung des neuen Mediums

beinflussbar ist, ohne nach Designern zu rufen: "In shaping what the

information infrastructure will become, we are also choosing what we want to

be."

Terry Winograd (ed.): Bringing design to software. ACM

Press, NY / Addison-Wesley, Reading, MA, 1996. Norwood, NJ: Ablex 1986.- Dt. Übersetzung 1989 bei Rotbuch, Berlin

Terry Winograd, Fernando Flores: Understanding

computers and cognition. A new foundation.

Semiotik

Eco, Umberto:

Einführung in die

Semiotik. Wilhelm Fink München, 1994. ISBN 3770506332.

Eco, Umberto:

Semiotik - Entwurf einer Theorie der Zeichen Muenchen : Fink, 1991. ISBN

3-7705-2323-7

Frieder Nake

(Hrsg.):

Die ertraegliche Leichtigkeit

der Zeichen : Aesthetik, Semiotik, Informatik. Baden-Baden : Agis-Verl., 1993. ISBN

3-87007-038-2.

Roman Jakobson. (Hrsg. von

Elmar Holenstein)

Semiotik :

ausgewaehlte Texte 1919 - 1982 . Frankfurt am Main :

Suhrkamp-Taschenbuch-Verl., 1992. ISBN 3-518-28607-2.

Charles S. Peirce:

Naturordnung und

Zeichenprozess : Schriften ueber Semiotik und Naturphilosophie. Frankfurt am

Main : Suhrkamp, 1991. ISBN 3-518-28512-2. G:129 591

Physiologie

Hans Peter Zenner:

Physiologie der

Sinne. Heidelberg Spektrum, Akad. Verl, 1994. ISBN 3-86025-251-8.

Sehsucht : ueber die

Veraenderung der visuellen Wahrnehmung. Kunst- und

Ausstellungshalle

der Bundesrepublik Deutschland GmbH. Red. Uta Brandes. Goettingen :

Steidl, 1995. ISBN

3882433507.

Welt auf toenernen

Fuessen : die Toene und das Hoeren. Kunst- und Ausstellungshalle der

Bundesrepublik

Deutschland. Red.: Uta Brandes. Goettingen : Steidl,

1994. ISBN

3-88243-311-6

Tasten. Kunst- und

Ausstellungshalle der Bundesrepublik Deutschland. Redaktion: Uta

Brandes. Goettingen

: Steidl, 1996. ISBN 3-88243-426-0

Geschmacksache.

Kunst- und Ausstellungshalle der Bundesrepublik Deutschland. Red.: Uta

Brandes. Goettingen :

Steidl, 1996. ISBN 3-88243-409-0.

Das Riechen : von

Nasen, Düften und Gestank. Kunst- und Ausstellungshalle der

Bundesrepublik

Deutschland GmbH. Red. Uta Brandes. Goettingen : Steidl, 1995. ISBN 3-

88243-385-X.

![]()

Uwe Krägeloh - Vorstellung seiner

Diplomarbeit

(Uni Wuppertal)

Stellte ein Kinderspielzeug vor welches aus einer Haupteinheit mit einem Bildschirm besteht und an das verschiedene Controller angeschlossen werden können. Schließt ein Kind z.B. einen Drehregler an so erscheint sofort ein entsprechendes Spielutensil auf dem Schirm z.B. ein elektronischer Ball. Werden nun noch zwei bunte Schieberegler angeschlossen so erscheinen zwei Klötze auf dem Schirm und so können die Kinder dann gegeneinander elektronisches Tennis spielen. Usw.

![]()

Axel Roesgen - Vorstellung seiner Diplomarbeit

(Uni Wuppertal)

ein

Kommunikationsgerät für UMTS

Im Rahmen des Vortrages von Herrn Stapelkamp habe ich meine Diplomarbeit vom

Wintersemester 2000/2001 an der Bergischen Universität Gesamthochschule

Wuppertal bei Prof. Dr. Nadin präsentiert:

Interface für ein drahtloses Kommunikationsgerät

Die 3. Generation des Mobilfunks (UMTS) erfordert eine neue Gestaltung der Interfaces. Die Displays der Geräte werden größer und der Anwender muss mehr Informationen verarbeiten. Daher ist eine humane Gestaltung der Bedienstrukturen und der grafischen Oberfläche erforderlich. In meiner Diplomarbeit habe ich bewusst die tradierten Interfaces nichteinfach weiterentwickelt sondern versucht einen neuen Ansatz zu finden .Kommunikation schafft Verbindung. Diese Metapher habe ich grafischumgesetzt.

Die Kontakte werden durch Fotos dargestellt und sind in einem so genannten "zoomable Interface" auf einer unendlichen Fläche angeordnet. Navigiert wird durch heran- und wegzoomen sowie durch verschieben in alle Richtungen. Dies hat den Vorteil, dass man schneller die gewünschte Kontaktpersonen findenkann. Die Bedienung erfolgt durch einen Stift. Will man eine Kommunikationsverbindungen herstellen, zieht man den Anfasser von einem der Kommunikationssymbole (Sprach, Sicht- bzw. Schriftkommunikation) zum

gewünschten Kommunikationspartner. Dabei wird eine Linie zwischen den beiden Symbolen aufgezogen. Auf diese Weise können auch mehrere Verbindungen gleichzeitig hergestellt werden, z.B. ein Fax verschickt werden, während man mit dem Gesprächspartner ein Videotelefonat führt. Oder es können schnell Konferenzgespräche aufgebaut werden. Die Verbindung wird beendet, indem man den Anfasser von der Kontaktperson wegzieht. Der Anfasser schnappt dann zum entsprechenden Kommunikationssymbol zurück.

Das Interface bietet dem Anwender zugriff auf einen Kalender und die persönlichen Daten der Kontaktpersonen sowie Tools zum bearbeiten der Kontakte und Einstellungen und Anzeigen von Empfangsqualität, Batterieladezustand und Uhrzeit. Des weiteren kann der Anwender auch auf Inhalte aus dem Internet zugreifen (Webseiten, Dokumente, Audio- und Videodaten, e-commerce und e-banking sowie weitere Programme, z.B. Spiele oder einen Taschenrechner) Das Umschalten erfolgt über einen Hardwarebutton neben dem Display.

Axel Rögen

geb. 1972 in Bergisch Gladbach

1992 Abitur in Rörath

1992-1993 Bundeswehr

1993 bis 1994 Praktika im Maschinenbau und im Architekturmodellbau

1994 bis 2001 Industriedesignstudium an der BUGH Wuppertal

1996 bis 1997 Studentische Hilfskraft bei Prof. Dr. Nadin im Computational

Design

seit 1998 Designbüro für Interaction-Design und 3D Visualisierung

Mäz 2001 Diplom an der BUGH Wuppertal im Fach Computational Design

![]()

Frieder Weiss – Palindrome

Performance System „EyeCon“

Demonstration

und workshop

Frieder Weiss ist Computeringenieur und Entwickler von Hard- und Softwareprojekten der Tanzkompanie palindrome. Bei dem Workshop stellte er das über Jahre hin entwickelte Motion- Tracking- System eyeCon vor. Hierbei handelt es sich um ein auf PC-Basis laufendes System welches eine genaue Bewegungsabtastung der Tänzer auf der Bühne erlaubt und auch die Zuordnung zu Midi-Steuerbefehlen zur musikalischen Kompositionssteuerung. So können sogenannte touch-lines oder Felder einfach mit der Maus in das Video-Monitor Fenster gezeichnet werden und diese wiederum Midi Steuerdaten zugeordnet werde. Es gibt sogar eine dynamische Auswertung der Felder, d.h. die Quantität der Bewegungen werden analysiert und zur Steuerung benutzt. Erstaunlich hierbei die hohe Performanceleistung des Systems in Punkto Geschwindigkeit, Flexibilität, Genauigkeit und Handhabung. Verschiedene Videosequenzen auf denen das System im Einsatz war, zeigten das Zusammenspiel von Tänzern und deren akustische Einflussnahme auf die Musik sehr deutlich. So konnte eine Hand eines Tänzers Tonkaskaden beeinflussen. Oder auch eine Komposition in Ihrem Fortgang in der Zeitachse unmittelbar beeinflusst werden. Das System läuft auf einem normalen PC System mit einer speziellen Videograbber-Karte. Im Moment arbeitet Weiss daran, dies mit einer normalen TV-Karte zu ermöglichen. Sogar der Einsatz auf einem Notebook wäre dann denkbar. Ebenfalls in Planung ist ein System mit dem dann auch Videodaten in Echtzeit manipuliert

werden können.

Frieder Weiß (frieder@palindrome.de) ist als freiberuflicher Ingenieur für Computertechnik für verschiedene Firmen in Nürnberg (u.a. Siemens) tätig. Er beschäftigt sich mit modernen Computer- und Bildverarbeitungssystemen in der industriellen Automatisierungstechnik und stellt musikelektronische Spezialgeräte her. Musiker für Theatergruppen (z.B. Thevomefüme, American Drama Group Europe, Nürnberger Jazz Art Ensemble.) Seit 2001 Direktor des Medienlabors „ 01-Plus - Institut für Kunst, Design und Medientechnologie“ an der Hochschule für Design in Nürnberg.

Frieder

Weiß (frieder@palindrome.de) is a free-lance computer engineer working for various companies in

Germany and United States (for example Bosch and Siemens). His specialization

is in the area of quality control and computer-imaging systems. He is a

designer of software and hardware besides being a musician with the groups

Thevomefüme, American Drama Group Europe, Nürnberger Jazz Art Ensemble.

Together with installation artist Reiner Hofmann he developed an interactive

installation work for the DATEV company. It is called 'Lichtbild' and

uses camera interactive technology to track the motion of individuals in an

entrance hall and convert them to light patterns on the adjacent wall.

Starting in 1995 he has worked with Palindrome as Interactive Systems

Designer and together with Robert Wechsler he has conceived and realized dozens

of performance and installation projects. He is the author of the EyeCon motion-tracking and analysis

software system. EyeCon is touted as one of the most flexible and

user-friendly systems of its kind in existence and is being used by artists,

singers, dancers and theater companies the world over. Mr.Weiß has also

designed miniaturized portable devises to allow the individual muscle

contractions of a dancer's body to control other media, as well as a system

making the dancer's heartbeat audible and available to control other media

(such as the tempo of the music). Since 2001 he has been became Director

of the Media Laboratory at 01-Plus Institute for Art, Design and Media

Technology at the State College of Design in Nürnberg, Germany.

Home-page Auszüge von palindrome:

Palindrome Inter-media

Performance Group

|

Wilkommen auf unserer Homepage.

Derzeit gibt es in der Welt kaum 10 Kompanien

die sich auf die Anwendung von Computern und neuen Technologien im

Tanz-Performance Bereich spezialisiert haben. Eine der führenden Beispiele ist

die Nürnberger Gruppe Palindrome. In den letzten 3 Jahren hat Palindrome eine

Reihe von Computerprogrammen speziell für den Einsatz im Tanz sowie spezielle

Tanzstücke mit interaktiver Computertechnik entwickelt

Viele Künstler benutzen den Computer heute als

kreatives Werkzeug. Andere zeigen den Computer als neues Medium und benutzen

ihn um neuartige, animierte Projektionen darzustellen, Internet-Art und

ähnliches. Unserer Meinung nach liegt das größte künstlerische Potential des

Computers weder in der Benutzung als Werkzeug noch in der Verwendung als neues

Medium. Vielmehr in der einzigartigen Fähigkeit ehemals unabhängige Medien zu

verknüpfen und in der Möglichkeit die künstlerische Arbeit auf verschiedenen

Gebieten zu vereinigen - Menschen auf neue Art zusammenzubringen.

Menschen tanzen und musizieren seit über 10.000

Jahre. Die meiste Zeit bildeten Musik und Tanz eine Einheit. In ihren frühesten

Manifestationen wurden Tanz und Musik einst als ein und dieselbe Kunstform

betrachtet. Es gibt heute noch afrikanische Traditionen, in denen nur ein Wort

für beides existiert! Ein wechselseitiger Austausch von Energien und Impulsen

zwischen tänzerischen und musikalisch-rhythmischen Aus-drucks-formen war die

Basis eines rituellen Ereignisses. In den westlichen Kulturen ist diese

Interaktivität, was das Performance-Medium Tanz betrifft, durch die weite

Verbreitung moderner Aufnahme- und Wiedergabetechnik weitgehend verloren

gegangen. Die meisten Tänze wer-den heute zu aufgezeichneter Musik getanzt. Im

selben Zuge wurde auch die Rolle des Publikums auf´s Zusehen und Applaudieren

reduziert.

Könnte die aufkommende digitale Technologie

Zeichen für eine "Umkehr in die Zukunft" setzen, in der eine neue

Interaktivität an die Stelle derjeni-gen tritt, die wir an frühere Generationen

verloren haben?

Palindrome's Interesse gilt der Interaktion.

Erst die jüngsten Softwareentwicklungen für Musik-komposition, Choreographie,

Klanggenerierung, Licht-design und die Bildenden Künste machen diese

voneinander unabhängigen Kunstformen miteinander kompatibel. Über ein

spezielles Computer-Kamera-System und über direkt am Körper befestigte

Elektroden werden Musik- und Text-Samples, Bühnen-licht und Bildprojektionen

gesteuert und stehen so in Interaktion mit den Bewegungen der Tänzer.

Auch das Publikum spielt in einigen der neuesten Stücke eine Rolle.

Beim Betreten des Theaters und durch die Bewegungen auf den Sitzplätzen, wird

es als interaktives Element ins Geschehen mit einbezogen.

Palindrome ist vor unterschiedlichstem Publikum

in Europa und den USA aufgetreten, einschließlich Theater, Festivals und

wissenschaftlicher Kongresse, in New York (u.a. Washington Square

Theater), ISIS-Symmetry Congress Washington DC, Case Western University,

IDAT99, Zentrum für Kunst und Medien Wissenschaft Karlsruhe, Gassteig Theater

München, Tafelhalle Nürnberg, Ludwigs-forum Aachen, Pfalzbau Theater

Ludwigshaven, Theater der Stadt Heilbronn, Danish Institute of

Electroacoustic Music Århus; Dresden Zentrum für Zeitgenössischen Musik).

Die Palindrome Dance Company wurde 1981 in New

York City gegründet und ist seit 1987 in Nürnberg, Deutschland, zu hause.

Palindrome erhält freundlichen Unterstützung von Siemens AG und der Stadt

Nürnberg.

Die derzeitige Truppe von Palindrome besteht aus 4 deutschen, schweizer und amerikanischen Künstlern und Wissenschaftlern, wobei die Anzahl Beteiligter für gegebene Vorstellungen auf 13 und mehr ansteigt, einschließlich zusätzlicher Tänzer, Sportler, Musiker, bildender Künstler, Computeringenieure, und andere.

Wir freuen uns unsere Ideen (künstlerische und technologische) mit Anderen zu teilen und auszutauschen. Eine gute Quelle für Informationen über andere Gruppen, die mit Tanz und Technologien arbeiten, ist The Dance and Technology Zone.

Mehr Information

Was ist ein "Palindrom" überhaupt?

Palindrome

Dance Company, Inc./e.V.

Johannisstr.

42 90419 Nürnberg Germany

Phone (49) 0911 - 397472

Fax (49) 911 - 3778311

Mobile (49) 179 - 511 0400

E-Mail an uns (pr@palindrome.de)

![]()

2.Tag 24.07.2001

Prof. Dirk Reith (Live-Elektronik in der Musik)

(Folkwang Hochschule

Essen)

http://icem-www.folkwang-hochschule.de/~reith/

Ging in seinem Vortrag der Frage nach, daß in der Musik schon immer Interfaces benutzt und gesucht wurden. Angefangen von den Hörnern und Trommeln bis hin zur Entwicklung der Streichinstrumente gibt es in der Musik mannigfaltige Interfaces. Diese erfordern jedoch auch eine sehr hohe Virtuosität der Spieler.

Orchesterintrumente haben sich nach der Sprache entwickelt. So analysiert das Programm MOSI von Kaegi Sprache und je nach Region und Unterschiedlichkeit der örtlichen Sprache haben sich auch dort verschiedenen Instrumente ausgebildet und entwickelt.

Bis Ende der 40er Jahre haben die Komponisten höchste Ansprüche an Instrumente gestellt. So z.B. eine spezielle Tubenform, nämlich die Wagnertuben wurden speziell auf die Bedürfnisse des Komponisten hin gebaut.

Die Entwicklung der klassischen Instrumente kann aber mehr oder weniger am Ende des 19. Jhd. als abgeschlossen angesehen werden. So wuchs der „Schwärzungsgrad“ der Partituren immer mehr an und immer mehr Parameter wurden von den Komponisten präzise festgelegt.

Aufgrund dieser immer anspruchsvolleren und präziseren Klangvorstellungen der Komponisten war es nicht besonders verwunderlich, daß sich nach dem 2. Weltkrieg die elektronische Musik entwickelte. Die Komponisten haben hierbei die volle Kontrolle über das Ergebnis. Vorher gab es jedoch bereits in Amerika, z.B. an der Princton-Universität die sog. Tape- Musik.

1948 mitbegründete Schaeffer in Paris die sog. Music-concrete, bei der aufgenommenes Geräuschmaterial musikalisch weiterverwendet wurde. Bei all diesen Formen der elektroakustischen Musik kam es jedoch zu großen Skandalen bei der Aufführung, da die Menschen bei dieser Musik nur Lautsprecher sahen. Die meisten Menschen sehen jedoch Musik, d.h. sie brauchen die sichtbaren Musiker auf dem Podium!

Beispiele:

Es gab 2 Richtungen in der Neuen Musik:

- neue Spieltechniken auf den traditionellen Instrumenten wurden entwickelt.

- elektronische Mittel werden hinzugenommen, hieraus entwickelt sich wiederum die live-elektronische Musik weil hierbei die Musiker freier im musikalischen Ablauf sind. Die Gleichzeitigkeit von Band und Live-Musiker hatte sich nämlich als sehr schwierig erwiesen! (Kontakte von Stockhausen für Musiker und Tonband/ mehrkanalig., sehr schwer aufzuführen!)

An der Folkwang-Hochschule hat sich ab 1971 die Live-Elektronische Musik entwickelt. Dazu wurden 3 Anlagen von der Firma Hofschneider und Prof. Reith konzipiert.

Es wurden dazu spannungsgesteuerte VCS 3 Synthesizer eingesetzt. Mit verschiedenen Mikrofonen (bis hin zu langen dünnen Messmikrofonen, die in Blasinstumente in die Röhren eingeschoben wurden) wurde dann das Instrument an verschiedenen Stellen abgenommen. Per Fußschalter konnte der Intrumentalist nun 7 Patches, Programmeinstellungen abrufen. Hierbei kamen hauptsächlich Ringmodulation, Amplitudenmodulation und Frequenzmodulation zum Einsatz. Es fand also hauptsächlich eine Erweiterung der Klänge durch deren Abnahme und Weiterverarbeitung statt.

Als Beispiel für einen Komponisten der extrem viel auf dem Gebiet der live-elektronischen Musik arbeitet sei Roland Pfrengle genannt, der mit interaktiven Interfaces arbeitete, und am Anfang noch gebaut aus Gattern, wie AND, NAND, OR, NOR seine Schaltungen aufbaute. Bei der Mikrofonabnahme der Instrumente benutzt er steilflankige Filter um die Töne zu analysieren und auszuwerten.

So gibt es 1982 ein Klavierstück von Pfrengle mit Live-Elektronik, bei dem der Spieler sozusagen einen virtuellen Begleiter, Mitspieler hat. So werden dadurch z.B. die Rotationsgeschwindigkeiten der Klänge im 4-Kanaligen Raum in der Geschwindigkeit gesteuert etc.

Die technische Veränderungen kann man Roland Pfrengle folgendermaßen einteilen:

Es gibt in den 70ern die Gatter-Schaltungen

80ern die Microprozessoren

90ern Computer und Software wie MAX und Supercollider

1991 „ZURÜCK“ ein Stück für Klarinette und Live-Elektronik

hier arbeitet Pfrengle bei der Abnahme des Instrumentes wieder mit seinen zuverlässigen steilflankigen Filtern im unteren Frequenzbereich und im oberen dann mit einem konventionellen Pitch to Midi Converter.

1999-2001 „METALL“ aus Gong und Singstimme

hier haben Ihn auch außereuropäische Musikkulturen beeinflusst. Es wird seit ½ Jahr geprobt und das techn . Setup besteht aus Macintosh G3 / MAX / Supercollider

![]()

Thomas Neuhaus

(Folkwang Hochschule Essen)

http://icem-www.folkwang-hochschule.de/~neuhaus/

Thomas Neuhaus stellte verschiedene Live-elektronische Stücke, unter anderem auch mit seiner Theatergruppe „Theater der Klänge“ vor.

Rückgekoppelte TapeLoops

Mithilfe von rückgekoppelten Tonbandmaschinen einem Mischpult und einem synthetischen Klangerzeuger konnte man seine Musik komponieren.

Drumprojekt

Lensing , Neuhaus 1985

Hierbei waren 4 Schlagzeuger mit jeweils einem Triggermikrofon ausgestattet. Die Bongo war für die Clock des A/D- Interfaces zuständig und konnte dieses sozusagen weiterschalten. Der Apple II lieferte Sequenzen

1990

„Die Küche“ Theaterstück von Arnold Wesker

hier spielte sich alles in einer Großküchenathmosphäre ab. Diese Küche wurde dann im wahrsten Sinne des Wortes verkabelt. Schubladenöffnen, Wasserhahnbetätigungen etc. lösten durch Midi vorgefertigte Samples aus.

Das Kotelettklopfen eines Kochs im Hintergrund gab den Beat vor. Ein Atari registrierte

die Auslösungen und hat die

Geräuschdramaturgie durch eine entsprechende programmierte Software am Ende der

Performance noch übersteigert.

Figur im Klang im Raum

Theater der Klänge !992/1994

Es gab ein Netz von Lichtschranken , das System GAMS (gesture and midi system), welches durch Laufzeitmessung die Position des Protagonisten, welcher einen drahtlosen Empfänger bediente oder trug, genau bestimmte.

Zusätzlich waren Sprachmikros aufgebaut. Es gab den AUDIAC- Computer für die DSP- Audio- Verarbeitung. Ein Lichtcomputer steuerte Licht und Diaprojektoren welcher mit Servo-Umlenk- spiegeln ausgestattet waren.

1995 KLANGRAUM INTERAKTIV

Eckert, Neuhaus , Reith

Dieses Projekt war im Dortmunder Rathaus installiert und mit einem mit 8 kanaligem Lautsprechersystem ausgestattet.Es gab mehrere Lichtschrankenfelder. Je nach der Häufigkeit mit der diese Lichtschranken von den Passanten durchschritten wurden, veränderten sich die dadurch ausgelösten Klänge, welche vom Sampler abgespielt wurden. Das Programm wertete die Anzahl der Lichtschrankenuntebrechngen als Ereignisdichte aus und veränderte z.B. Zuordung der Lichtschranke zu einem bestimmten Sound. Wurde das quietschende Schwein zuerst durch Lichtschranke 1 ausgelöst, so geschah dies plötzlich mit Lichtschranke Nr.4 usw. So gab es keine erkennbare Zuordnung mehr. Dies wiederum frustrierte die Leute, welche dann das Spiel verließen und führte zu einer Abnahme der Ereignisdichte und das ganze System kehrte zum Ausgangszustand zurück.

Tilt –

and yet it moves

Hörner, Neuhaus, Reith, Steger 1996

In einem Laserlichtschrankenfeld befanden sich zwei große Kugeln welche per drahtlosem Funk ferngesteuert werden konnten. Dazu gab es eine interaktiv zu diesen Kugeln sich bewegende Tänzerin mit eigener Choreographie, die sich der Situation anpassen musste.

vita

http://icem-www.folkwang-hochschule.de/~neuhaus

Thomas Neuhaus (*1961) studierte an der Folkwang-Hochschule Komposition bei Wolfgang Hufschmidt und elektronische Komposition bei Dirk Reith. Als Komponist arbeitet er mit dem Theater der Klänge, Düsseldorf und unterrichtet am Institut für Computermusik und elektronische Medien ( ICEM ) der Folkwang-Hochschule Essen.

Er ist Mitentwickler des AUDIAC Projektes zur computergestützten Komposition und Klangsynthese und entwickelte verschiedene Kompositionssprachen und Realzeitsysteme. Neben den verschiedensten Verbindunge von (elektronischer) Musik und Bühnenkünsten interessieren ihn vor allem Aspekte der Formalisierung und automatischen Generierung musikalischer Strukturen.

Seine Musik wird, ebenso wie seine Computerprogramme international auf entsprechenden Festivals und Konferenzen präsentiert.

![]()

Prof. Jörg Lensing

(FH Dortmund)

„Wenn

Interaktion von Performern auf Bühnen mit einem elektronischen Equipment geplant

sind, hat man einerseits den Anachronismus von Studioinstrumenten, die nicht

für einen Bühnengebrauch konzipiert sind, aber in ihrer “kleinen“

Interfacedimension für ein Publikum fast nicht einsehbar gebraucht werden.

Plant man andererseits „große“ Interfaces, stellt sich immer die Frage nach den

bühnenspezifischen Erfordernissen. Es reicht nicht kleine Hebel oder Räder zu

vergrößern, sondern man muß auch bewegungsspezifische, darstellerische und

kontextuelle Aspekte beim Design von Bühneninterfaces berücksichtigen. Der

Vortrag soll diese performerspeziflsche Problematik bewußt machen.“

PCI

- Probleme für Bühnenperformer

oder:

Die

Kunst, die richtige Dimension zu finden

Mein Vortrag

konzentrierte sich auf die wahrnehmbare gestische Dimension eines

Bühnenperformers, der vor einem größeren Publikum agiert, welches sich 5m bis

40m von ihm entfernt befindet.

Der IST-Zustand

bei klassischen Konzerten:

Bläser

Tasteninstrumente

Streicher

Schlagwerk

Dirigent

Der IST-Zustand bei Pop-Konzerten:

Blasinstrumente

Tasteninstrumente

Gitarren &

Bässe

Schlagzeug

Sängerinnen &

Frontmänner

Der

IST-Zustand auf Bühnen:

Theater:

Sprechtheater mit

Musik

Oper

neues Musiktheater

Ballett

Tanztheater

Performance &

Präsentation (Show)

elektronische Musik

Pop:

Schulze,

Tangerine, Kraftwerk

DJ´s, E-Tracks, Laptopartist.

E:

Der Komponist als

Priester

Instrumentalmusiker

& Computer

„interaktive Bühnenperformances“

Kaoss-Pad oder

Bewegungsbeam

Teremin

Objekte

verkabelte Tänzer

Lichtschrankennetze

Ultraschallmikrophone

Kameratracking

Zur Verarbeitung von

Bühnenbewegung, welche durch stationäre Kameras aufgenommen werden, gibt es

Dimensionen, die einem in diesem Zusammenhang bewußt sein müssen:

Raum,

vor allem

Raumtiefe

Bewegung,

vor allem Bewegungsdynamik

Visualisierung von

virtuellen oder realen Steuerobjekten (für den Performer und für das Publikum,

da ansonsten nicht nachvollziehbar ist, was da überhaupt passiert)

Synchrese & Valeur ajoutee

Synthese + Synchronisation = Synchrese (Michel Chion)

Valeur ajoutee

(hinzugefügter Wert) = Mehrwert (Chion / Flückiger)

Zitat:

Im

Prozeß der intermodalen Assoziation kombiniert der Rezipient die

unterschiedlichen Merkmale, die sich aus dem bildlichen und klanglichen

Repräsentationen ergeben, zu einem sinnvollen Ganzen. Das sind Merkmale der

Form, der Farbe, der Oberflächentextur, die sich im Bild manifestieren; es sind

Prozesse und Bewegungen, die sich in der Synchrese einander anpassen; es sind

physikalische Eigenschaften, die aus der klanglichen Form induziert werden, und

affektive Qualitäten, die mit der Klanglichkeit korrespondieren. Je weiter die

Darstellungen sich von einer prototypischen Vereinfachung entfernen, umso

größer ist der Mehrwert, der dabei entsteht.

Barbara Fluckiger

in „Sound Design“ (S. 146)

Rechner folgt der

Bewegung

am Beispiel der

CD-ROM:

William Forsythe -

Improvisation Technologies

Bhava / Rhasa

... und affektive

Qualitäten, die aus der Klanglichkeit korrespondieren...

Wunschvorstellung:

Rechner folgt Bewegung

und ordnet differenziertes klangliches Material der Bewegungsdynamik, der

Raumposition und der semantischen Intention der

Regie/Choreografie/Improvisation zu

Jörg U.Lensing

FH-Dortmund

joerg.lensing@fh-dortmund.de

www.film-sound-design.de

THEATER DER KLÄNGE

theater-der-klaenge@t-online.de

www.theater-der-klaenge.de

![]()

Live Performance-worshop vom Theater der Klänge

mit Thomas Neuhaus, Clemente Femandez und Prof. Lensing:

Mit ihrem System von BigEye einer Software von STEIM

http://www.steim.nl/bigeye.html

|

|

|

|

|

|

||||||||

|

|

|

|||||||||||

|

|

|

|

|

|

||||||||

„Mit Hilfe einer

Consumer-DV-Kamera, einem G3 Laptop für die Software , Big Eye und einem Apple

G4 für die Controllerdatenverarbeitung mittels MAX/ MSP zeigt das Team, welches

derzeit in einer Kooperation von ICEM Essen und dem Theater der Klänge

Düsseldorf an dem Forschungsprojekt „bewegungsgesteuerte Sprachtransformation

arbeitet, was konkrete Umsetzungen von Bühnenbewegung und Live-Sampling in

musikalische Strukturen bedeuten kann. Dazu stehen diverse Setups sowohl in Big Eye, als auch in MAX zur

Verfügung, die in ihrer Funktion demonstriert werden können. Diese Setups sind

größtenteils so leicht zu verstehen, daß die Performer direkt auf Zuruf auch

Vorschläge damit ausprobieren können, respektive Workshopteilnehmer am

Nachmittag selber mit dem System experimentieren können.“

Verschiedene Setups wurden vorgeführt:

1.

Der Bühnenraum wird abgetastet und z.B. in Segmente, bzw. vertikale Bahnen eingeteilt. Tritt der Sänger mit einem gelben T-shirt ( das System kann Farben unterscheiden) in ein solches Feld, wird jeweils das, was er in diesem Feld ins Mikro singt vom Live-elektronischen System, bestehend aus G4 , MAX) aufgenommen und algorithmisch verarbeitet und wiedergegeben. Tritt jetzt ein zweiter Schauspieler mit einem schwarzen T-shirt auf die Bühne so kann z.B. der „Schwarze“ als Trigger dienen. d.h. er bestimmt jetzt wann ein Klang oder Laut (vom „Gelben“ erzeugt) aufgenommen wird.

2.

Das Programm generierte eine Anzahl von Klangstimmen je nach Entfernung des Tänzers zu der Kamera, d.h. das System reagiert auf die Größe des Protagonisten zur Kamera hin und entsprechend dazu verhält sich die Polyphonie dazu.

3.

Wenn der Tänzer sein T-Shirt hebt, also die Farbe verändert ändert sich ebenfalls der Sound.

Nach dieser Demonstation der Gruppe „Theater der Klänge wurde von den Teilnehmern des Workshops experimentiert...

Danach

Vorführung des KORG KAOSPAD

Hierbei handelt es sich um einen Multieffektprozessor, der über ein Touchpad gesteuert werden kann. Mann kann so z.B. auf verschiedene Ecken des Pads verschiedene Effekte legen. Rechte Obere Ecke Hall , untere linke Ecke Pitch-shifting und man kann dann wie mit Schiebereglern kontinuierlich eben über dieses Touchpad die Effekte verändern oder überblenden etc.

![]()

Thomas

Karstens (Uni

Köln)

Die

Gitarre - vom konventionellen Klangerzeuger

zum

Interface (Demonstration)

MIDI GITARRE Demonstaration des Gitarren-Baumesisters Frank Krokker in München

Mit einem Axeon Gitarrensynthesizer bzw. Pitch to Midi Converter von Blue Chip der mit neuronalen Netzen arbeitet und dehalb extrem schnell die Tönhöhen erkennt. Ebenfalls alle anderen Ausdrucksweisendes des Gitarrenspiels wie Seitenziehen oder auch die Position an der die Seite gezupft wird, werden erkannt und können als Midi- Controller Daten umgewandelt werden.

Auch Seitensplitting ist möglich. Auf der tiefen E-Seite z.B. ein Orgelsound auf der h Seite ein Midi-Cembalo etc.

Kurzvita Thomas Karstens

1959 in Itzehoe geboren

nach erstem Musikunterricht in Lübeck und Hamburg (Prof. Klaus Hempel)

1981/82-88 Beginn des Musikstudiums an der Musikhochschule Köln

(Gitarre bei Wulfin Lieske, Tonsatzfächer bei Prof. Günther Fork,

Kammermusik bei Mitgliedern des AMADEUS-Quartetts)

während dieser Zeit verschiedene Meisterklassen für Gitarre(u.a. an

der Academia Chigiana, Siena, als Stipendiat des DAAD)

bis 1991 Studium an der Schola Cantorum in Paris, "Diplome

Excellence" und privater Unterricht bei dem brasilianischen

Gitarrenvirtuosen Odair Assad in Brüssel

seit 1991 Lehrbeauftragter am Seminar für Musik an der Universität

Köln für Gitarre und Tonsatz für Gitarristen

CD- und Rundfunkproduktionen (WDR-Köln, Radio Nacional de Ecuador),

zahlreiche Uraufführungen

Gastdozent an den Konservatorien und bei Gitarren-Festivals von

Managua ,Quito und Izmir auf Einladung von Deutscher

Musikrat,Jeunesse Musical,Humboldt-Stiftung und Goethe-Institut

Konzerte in In-und Ausland

Internetinformationen: http://www.thomaskarstens.de/

In dem Vortrag "Die Gitarre - vom konventionellen Klangerzeuger zum

Interface" wird ein Instrumentensetup vorgestellt, das aus einer

halbakkustischen Gitarre mit integriertem Piezo-Tonabnehmersystem und

dem Guitar-to-Midi-Converter Axon AX100 der Firma Bluechip besteht.

In dieser Konstellation ist, abgesehen von der reinen

Klangverstärkung, die Anbindung der Gitarre an midifähige Hard- und

Software in einem Umfang möglich, der in einigen Bereichen weit über

den bekannter Midi-Einspielinstrumente hinausgeht. Die Aufteilung von

Griffbrett, Saiten und Anschlagsbereichen der rechten Hand in Zonen,

denen unterschiedlichste Midi-Events zugeordnet werden können,

erlauben eine differenzierte Kommunikation zwischen dem Spieler und

einem midifähigen System über das Gitarreninterface.

![]()

Prof. Jens Herder

(FH Düsseldorf)

Räumliche Schallreproduktion

für interaktive Anwendungen

http://vsvr.medien.fh-duesseldorf.de/~herder/events/sa2001.html

Die Folien zum Vortrag sind unter diesem link einsehbar:

http://vsvr.medien.fh-duesseldorf.de/~herder/presentations/sa2001rsia-Dateien/frame.htm

Der Vortrag fand im Rahmen der Sommerakademie der AG Audiovisuelle Medien der Hochschulen NRW statt. Das Thema war Performer Computer Interfaces.

Ausgewählte

Links zum Vortrag

- Intersense IS-900IT Camera

Tracking System

- Mandala VR System

- The House on the Rocks

- Mikami Seiko: World, Membrane

and the Dismembered Body, 1997, ICC, Hatsudai

- Akitsugu Maebayashi: Audible

Distance, 1997, ICC, Hatsudai

- Jens Herder, Michael Cohen,

"Project Report: Design of a Helical Keyboard", ICAD -

International Conference on Auditory Display, Palo Alto, November, 1996

- Yasuhiro Yamazaki and Jens

Herder. Exploring Spatial Audio Conferencing Functionality in Multiuser

Virtual Environments, Third International Conference on Collaborative

Virtual Environments, ACM, San Francisco, September, pp. 207-208 , 2000.

Last modified: 07/29/01; Contact: herder@fh-duesseldorf.de; Copyright © 2001, Jens Herder, All

Rights Reserved.

[HOME] [PUBLICATIONS] [PRESENTATIONS] [LAB] [EVENTS] [EDUCATION] [RECREATION] [SEARCH]

Jens Herder ist Professor im Fachbereich Medien an der Fachhochschule

Düsseldorf. Im Labor für virtuelles Studio / virtuelle Realitätexperimentiert

er mit Interaktionsformen für neue Medien.

Nach dem Studium der Informatik mit Nebenfach Architektur an der Technischen

Hochschule Darmstadt hat Prof. Herder als Software Ingenieur bei Symbolics

Systemhaus GmbH gearbeitet. In einem Projekt für Lufthansa entwickelte er eine

objektorientiert, versionierte Datenbank, welche Basis für eine Flugplanungssoftware

bildete. Er war verantwortlich für das gemeinsameProjekt mit dem Forschungszentrum

für Informatik an der Universität Karlsruhe zur Entwicklung eines Common Lisp

Interface Builders.

1993 baute Herder an der neugegründeten Universität von Aizu in Japan das

Computer Industry Laboratory auf. Dort unterrichtete er Computer Graphik,

Algorithmen und Programmierung. Er leitet studentische Forschungsprojekte

zur Bildverarbeitung (Anwendung Sake-Abfüllungsqualitätskontrolle) und zu

virtuellen Umgebungen. In dem Forschungsprojekt das Intelligent Dental Care

System war er für die Benutzerschnittstelle verantwortlich. Als Mitglied der

Spatial Media Group leitete er die Entwicklung des Sound Spatialization

Framework. 1999 erhielt er die zusätzlich Ernennung zum Research Center for

Advanced Technology mit Schwerpunkt Anwendungen für das Gigabit-Projekt. Im

selben Jahr erhielt er auch seinen Doctor of Philosophy in Engineering von

der Universität Tsukuba. Seine Dissertation befasste sich mit der

Betriebsmittelverwaltung für räumliche, akustische Displays mit ihrer

Anwendung in virtuellen Umgebungen. Zuletzt war er als Assistant Professor

im Shape

Modeling Laboratory in Aizu tätig.

![]()

VLIGHT

(Uni Essen)

Theis Müller, Stefan Landrock, Karsten Blaschke

(Visualisierung von elektronischer Musik – realtime motion processing)

Ist eine Gruppe von Designstudenten aus Essen, welches zu Ihrer Diplomarbeit ein Macromedia -Flash basiertes Programm entwickelt hat um Musik, speziell techno oder house Musik mit Bildern zu visualisieren. Hierbei wurde ein sehr praktischer Weg beschritten. Es wurde eine konventionelle Lichtorgel mit einem Gamepad eines Computers hardwaremäßig miteinander verkoppelt. Hierüber werden dann drei Frequenzbereiche analysiert und dem Flash- Player zugeführt. Hier werden dann die Bilder oder Videos live ausgelöst, gemischt etc. In diesem eigens entwickelten Programm hat man vorher schon fertige Bilder und Videos eingeladen. Bis zu vier Videostreams können in Echtzeit gemischt werden. Die Gruppe tritt live bei techno- Partys auf und sorgt hier für die visuelle Umsetzung eines Raves. Die Vlight-Gruppe muß hierbei eine Einheit mit dem Audio DJ bilden. Sie vertrauen hierbei auf Synästhesie –„Je mehr Sinne gleichzeitig durch ein Ereignis angesprochen werden desto vertrauenswürdiger erscheint die wahrgenommene Information.“

Als Programmierwekzeuge werden V 505D, Flash 5, MYSQL, PHP benutzt.

|

VLIGHT

IS ABOUT VISUALIZATION OF ELECTRONIC DANCE MUSIC |

# |

|

VLIGHT

is a graduation project. It´s about visualization of electronic dance music

in a life-experience. It is an experiment dealing with moving graphics driven

by sound all mixed togehter for a roaring e-trash happening. VLIGHT are design-students

from the university of Essen,Germany and besides beeing web-designers we had

several gigs in germany as VJ`s in the most likely clubs around. VLIGHT is developping hard-

and software interfaces for realtime-motion-processing based on a

shockwave-flash enviroment. Our application let you modify the animation in

realtime on several parameters like direction, speed, color, multilayering,

scratching etc. Our hardware interface makes it possible to trigger the

animation to sound. |

|

Our totally Flashbased VJ-Interface V505rd will be available for

download soon. |

|

|

|

|

|

|

|

|

cube |

basement |

fink_club |

kiss_loud |

ralf_mixma |

the_wall |

|

|

|

|

|

|

|

|

him_and_her |

to_much_stuff |

thomas_geier |

|

of_main |

glance_or_olli |

|

|

|

|

|

|

|

|

don´t flash |

RJ_bar |

tonka |

flamingo-boys |

youre |

flamingo-girls |

|

|

|

|

|

|

|

|

plusminus |

flamingo-cat |

kalle |

aftershock |

metro_area |

dotter |

|

|

|

|

|

|

|

|

dotburn |

dotcom |

welcome |

offenbach |

check_out |

balkony |

|

|

|

|

|

|

|

|

prepare |

giant_desk |

mariko&francis |

on_stage |

DSC00005 |

|

|

VLIGHT |

phone +49(0)201-3164866 |

http://www.sichtwerk.uni-essen.de/

![]()

(Kunsthochschule für

Medien Köln)

Er ist postgraduierter Student an der Kunsthochschule für Medien in Köln.

Diese Arbeit, der Titel heißt ‘implex‘, wurde in diesem Jahr gemacht und im April in der Moltkerei Werkstatt in Köln, im Juli in der Trinitartis Kirche und während der Semesterausstellung der Hochschule für Kunst und Medien in Köln, ausgestellt.

Womit ich mich in dieser Arbeit auseinandergesetzt habe ist die Mobilität und Veränderbarkeit der musikalischen Strukturen, Klangfarbe z.B. wie im Bereich der Skulptur und hier die der Mobile von dem amerikanischer Bildhauer Alexander Calder. Im Bereich der Musik die freien stochastischen Kompositionskonzepte von Iannis Xenakis

Durch digitale Medien wird der Raum in dieser Arbeit in eine unlokalisierbare, virtuelle und heterogene Schnittstelle umgewandelt bzw. diese simuliert.

Dafür programmierte ich SOM – Algorithmen (self-organisation-map} um den Rechner uneindeutig erscheinen zu lassen aber nachvollziehbar, ähnlich einem Symptom in der Natur. Auf jedes Element selbst wird eine Veränderlichkeit gebracht.

Eindeutigkeit ist deshalb nur begrenzt auf ein in realtime arbeitendes Interaktionssystem anzuwenden, und gilt vor allem in einer solchen Raum-Klanginstallationssituation. Wie der Stochastiker Markovian es formuliert hat:“ Die Vergangenheit hat keinen Einfluß auf die Zukunft des Prozessverlauf, wenn die Gegenwart bekannt ist!

Betritt nun ein Betrachter den Raum, so analysiert der Rechner die Farbe und vergleicht sie mit den Daten des leeren Raums. (initiierte Parameter)

Dadurch kann der Rechner erkennen wo sich der Betrachter befindet. Diese Position wird als „Reiz“ für die SOM (self-organisation.map) übersetzt. Dieser SOM-Algorithmus besteht aus 8 Zellen, welche aus jeweils 40 Sinus-Oszillatoren bestehen. Sie suchen nun ständig einen neuen Reiz oder einem Nachbarn. Jeder hat sein eigenes Gewicht, Trägheit und Geschwindigkeit. Dieser leitet sich aus dem Abstand zwischen Reiz und Zelle ab. Wenn sich eine Zelle z.B. zu weit von einem Reiz entfernt befindet, wird sie deaktiviert und wartet auf einen neuen Reiz oder einen Nachbarn, um einen Knoten zu binden um sich wieder aktivieren zu können. Dadurch entstehen permanent neue Konstellationen.

Die speziellen Lautsprecherboxen wurden aus ästhetischen und akustischen Gründen gebaut.

Oben befindet sich der Hochtöner mit einem Frequenzbereich von 2000- 25000 Hz. Unten ist der Tief- Mitteltöner im Frequenzbereich von 25-3000 Hz angebracht.

Somit wird der Klang so abgestrahlt, dass es eine Ähnlichkeit mit dem Bild von Magnetlinien im Raum hat. Der Betrachter kann den Klang nicht genau lokalisieren.

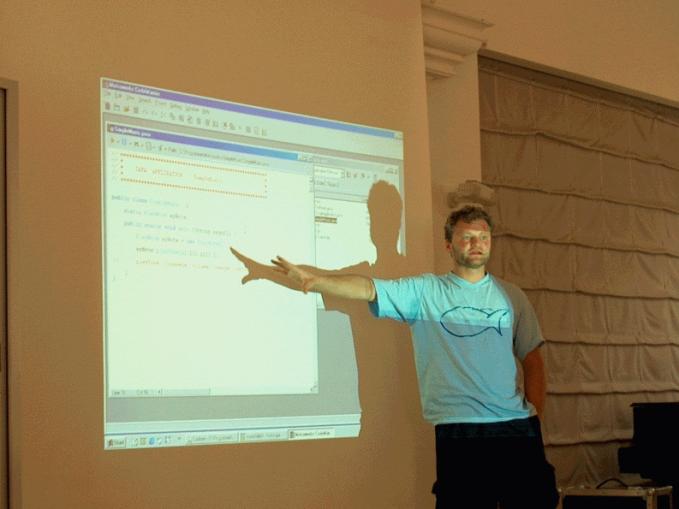

![]()

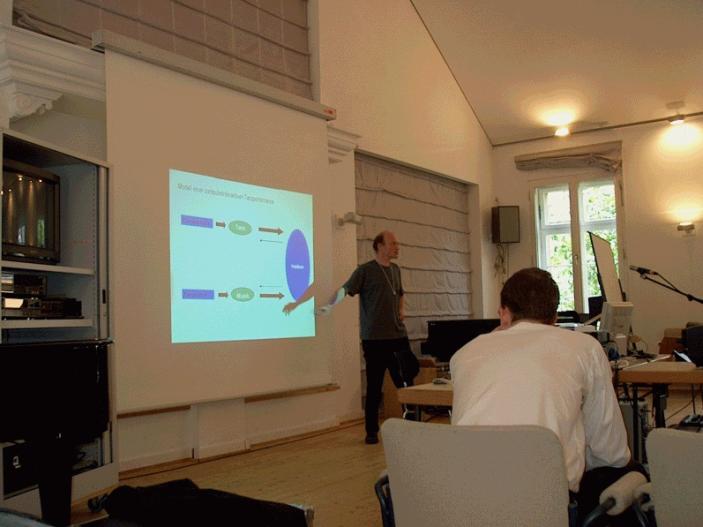

Dr. Jochen

Viehoff

(Kunsthochschule für Medien

Köln)

http://www.khm.de/~viehoff/Applets/

Vortrag:

"Mensch-Maschine Schnittstelle und Interface-Design - Eine JAVA basierte

Lern- und Ausbildungsplattform."

In der Präsentation wurde die Ausbildungsplattform der KHM (Kunsthochschule

für Medien) im Bereich der Mensch-Maschine Schnittstelle vorgestellt.

Basierend auf mobilen Computer-Arbeitsplätzen und speziellen Mess-Computern

erlernen die Studierenden im Interface-Labor den Umgang mit Sensoren und

Kleinst-Robotern. Anhand von drei unterschiedlichen Sensoren wurde bei der

Sommerakademie konkret demonstriert, wie Umweltdaten innerhalb einer JAVA

Plattform zur Verfügung gestellt werden und welche multimedialen

Möglichkeiten zur Weiterverarbeitung gegeben sind.

________________________________________________________________________

Dr. Jochen Viehoff Tel.: +49 (0)221 20189354

Kunsthochschule für Medien Köln Fax.: +49 (0)221 20189230

Peter-Welter-Platz 2 email viehoff@khm.de

D-50676 Köln Germany

CV:

Jochen Viehoff, geb. 1968 in Wuppertal, studierte Physik in Wuppertal, Pisa

und Edinburgh. Er promovierte 1999 auf dem Gebiet der theoretischen

Elementarteilchenphysik und ist seit 1999 kuenstlerisch/ wissenschaftlicher

Mitarbeiter an der Kunsthochschule für Medien Köln. Seine

Forschungsschwerpunkte sind die Entwicklung von Mensch-Maschine

Schnittstellen, Sensorik und Robotik. Seit 2000 betreut Jochen Viehoff den

Aufbau bzw. Ausbau des Interface-Labors an der Kunsthochschule fuer Medien.

Es können verschiedene Interfaces an das System angeschlossen werden. Die Künstler können diese Sensoren selbst auswählen. Ausbildungsplan an der KHM.

Modulcharakter. Dadurch entsteht Motivation und ein Lernprozess mit diesen Interfaces und deren Interaktivität.

- Semester Computerkurs

- 2. JAVA simple music, image player

- Interface Design, Sensorik, Robotik...in Fachseminaren

Networks : Code warrior

Mit Java und hier speziell der Sound-Programmierung werden die Studenten in die Materie eingeführt.

http://interface.khm.de/about.html

Dies ist der Arbeitsraum für den Umgang mit Software, Hardware, Interfaces, Roboter

Hier wird auch mit eye-tracking (was macht das Auge) und motion- tracking gearbeitet.

USB Frame

Grabber, lego Roboter

Mit Laptops für die Studenten und einem drahtlosen Netzwerk kann so in jedem Raum eine einfache und professionelle Arbeitsathmosphäre hergestellt werden.

Daran angeschlossen wird über USB ein batteriebtriebener Messcomputer (Lab Pro von Vernier). Hieran können die verschiedenen Sensoren wie Ultraschall, Wärme, Feuchte etc. angeschlossen werden. Dies alles findet unter einer JAVA- Plattform statt.

Benutzte Software:

D und 3D API´s, Mediaframework, Sprach- Ein- und Ausgabe, IBM Via Voice, Quicktime

KHM

mutimedia toolkit

Interface

toolkit

Internet

tollkit

Midi, audio

Video

compositing

Media frame

board

Warum JAVA?

Vollstädigste Plattform für die unterschiedlichsten Medien: Video, Audio, I/O, Sprache, „D, 3D und VR (virtual reality)

Lab Pro: Messcomputer von Vernier der über sereille oder USB Schnittstellen angeschlossen werden kann.

20 khz Sampling rate

- biologische Sensoren

- chemische Sensoren

- physkalische Sensoren

- sonstige

Dr. Viehoff demonstrierte ein einfaches Java Programm , bei dem ein einfacher Ball auf dem Computerbilschirm durch wenige Zeilen Code in der Abhängigkeit der Entfernung des Betrachters zum angeschlossenen Ultraschallsensor sich in seiner Größe veränderte.

Die Studenten sollen über einfache Java Programmierung sofort mit den Modulen umgehen lernen und damit Ergebnisse erzielen! Diese Anwendungen können natürlich auch alle über ein Netzwerk laufen.

Beispiele dieser Applets stehen auf dem Internet-Bereich von Herrn Dr. Viehoff.

![]()

Prof. Oliver

Wrede

(Fachhochschule Aachen)

http://mg.khm.de/mitarbeiter/owrede

Studierte Design an der Fachhochschule Köln, Fachbereich Design. 1996 gründete er mit drei anderen Designern die Agentur causa formalis informationsdesign.

Er ist an der KHM seit Oktober 1999 künstlerisch-wissenschaftlicher Mitarbeiter im Bereich "Interaktive Medien und Netzwerke". Seit dem Wintersemester 2000 ist er außerdem Vertretungsprofessor für das Lehrgebiet Medientheorie/Medienpraxis am Fachbereich Design

http://webdev.khm.de, http://owrede.khm.de

Vortrag:

"Das Interface zum

Interfacedesign"

Zusammenfassende Gedanken

zum Begriff des Interfaces im Zusammenhang

der "Performer

Computer Interaction"-Vortraege an der Sommerakademie

2001. Hinweise auf

physiologische, mentale, kognitive,

psychologische,

kommunikative, soziale, kulturelle und aesthetische

Bedingungen der Interfacegestaltung.

PAUSEN

DISKUSSION

AM ENDE

In der Diskussion ging es um Gedanken der einzelnen

Teilnehmern zu dem Thema Interface. Hier wurde von vielen die enorme

Informationsvielfalt der diesjährigen Akademie gelobt. Jeder hat etwas

mitgenommen. Es gab Projekte von denen man untereinander gar nicht wusste, dass

es sie überhaupt gibt. Diskutiert wurde auch das gegenseitige Interesse der

einzelnen Fachrichtungen aneinander, da man gerade in der heutigen Zeit des

vielzitierten „Multimedia“ auch über die anderen Sparten Bescheid wissen muß

und diese teilweise in die eigene Arbeit mit einbezieht. Das „Multi“ ist also

teilweise schon Praxis geworden. Angerissen wurde auch die weitere Zukunft der

Akademien, da sich das ganze Geschehen und Engagement in dieser Hinsicht von allen Beteiligten auf ehrenamtliche Basis

gründet. So bedankte man sich auch vor allem bei Frau Wallenzus. Mit ihrer

Hilfe konnte eine so interessante und spannende Sommerakademie wieder auf die

Beine geststellt werden und alle hoffen darauf, dass endlich die staatlichen

Stellen das Potential eines solchen Meinungs- und Wissensaustausches in Form

einer solchen Sommerakademie erkennen mögen um das Bildungssystem in diesen

Disziplinen in Zukunft noch effektiver nutzen zu können.

FINE

Hinweis:

Am Dienstag den 11.12.2001 ist ein Planungstreffen an der

FH-Bielefeld für die 4. Winterakademie unter dem Arbeitstitel „Der Ton im Bild

– das Bild im Ton“ , welche vom 18.2. 2002 an der FH-Düsseldorf und anderen

Hochschulen in NRW durchgeführt wird.

Angela Wallenzus, M.A.

K.- Kreiten Str. 16

40724 Hilden

E-Mail: awallenzus@web.de

Angela Wallenzus

(Planung, Koordination, Durchführung der Akademien)

Konzept der Arbeitsgemeinschaft

„Audiovisuelle Medien“ der nordrhein-westfälischen Hochschulen

"Ein Interdisziplinäres

hochschulübergreifendes Projekt"

Im Rahmen der Akademie sollen gemeinsame Ressourcen

(Fachdozenten, Ausstattung, etc. ...) zum Thema „Ton- und Bildverarbeitung

/-gestaltung“ genutzt werden. Es werden praktische und theoretische Anteile

vermittelt und spezielle Themen in den Seminaren erarbeitet (siehe Programme im

Anhang).

Eine jeweilige Zertifizierung der vermittelten

Inhalte wird von den veranstaltenden Hochschulen nach Durchführung zugesichert.

Die Inhalte und Ergebnisse der Akademien sind im Internet oder auf CD-Rom

nachzulesen.

Das

Ziel der in Folge beschriebenen Veranstaltungen soll ein Anfang sein, Studenten

aus den medienspezifischen Studiengängen in NRW, ergänzende Studieninhalte

hochschulübergreifend aus dem vorhandenen Fächerangebot zugänglich zu machen.

Die Nutzung der daraus resultierenden Synergien in der Ausbildung, ermöglicht

den Studenten wären des Studiums ergänzende Qualifikationen zu erwerben und

Netzwerke/Kontakte aufzubauen. Langfristig sollen sich diese Ergänzungen

curricular als Wahl-/Wahlpflichtfächer im jeweiligen Studiengang etablieren.

Des weiteren wir der Austausch zwischen Professoren, Dozenten und Fachleuten zu

aktuellen Themen angeregt.

Es steht im Landesinteresse, vorhandene Ressourcen

an den Hochschulen zu bündeln, das Fächerprofil der Hochschulen zu schärfen und

standortübergreifende Modelle zu entwickeln.

Das Konzept soll mittelfristig auf andere Themen im

audiovisuellen bzw. informationstechnischen Bereich übertragbar sein.

Es sind schon zwei Sommerakademien

und eine Winterakademie gemeinschaftlich von verschiedenen Hochschulen

durchgeführt worden. Die letzte „Sommerakademie“ vom 23.- 26. Juli 2001 mit den

entsprechenden Fachbereichen fand an der Folkwang-Hochschule statt. Das nächste

Planungstreffen wird am 15. Oktober 2001 an der Fachhochschule Dortmund

durchgeführt.

Falls die Akademien

weiterhin erfolgreich verlaufen sind weitere Blockveranstaltungen mit anderen

entsprechenden Fachbereichen möglich, z.B. zu den Themen/Arbeitstitel

„Computeranimation/DVD“ und/oder “Virtuelle Netzwerke“, damit eine

Kontinuität und Etablierung der

Veranstaltungen in diesem Rahmen gewährleistet ist.

Die

4. Akademie wird zum Thema (Arbeitstitel) „Das Bild im Ton- der Ton im Bild“

vom 18. – 22.2.2002 an der TH Düsseldorf und anderen Hochschulen in NRW

durchgeführt.

Drei

PROGRAMME der Arbeitsgemeinschaft

„Audiovisuelle Medien“ der nordrhein-westfälischen Hochschulen von Juli 2000 bis Juli 2001

"Ein interdisziplinäres hochschulübergreifendes Projekt"

- Programm Sommerakademie

„Audiovision“ (AV) vom 17.-19. Juli 2000-

Für

die Durchführung des Pilotprojektes „Sommerakademie Audiovision“ hatten sich

kooperativ die drei Hochschulen und Professoren/Dozenten

·

der Folkwang-Hochschule Essen (Prof. Dirk Reith)

·

der Hochschule für Musik Detmold (Prof. Carlos Albrecht)

·

der Fachhochschule Dortmund (Prof. Jörg Lensing)

als

Veranstalter zur Verfügung gestellt.

Eine

Modellgruppe von 16 Studenten entsprechender Studiengänge von der

·

FH Düsseldorf (Design, Medientechnik),

·

Robert-Schumann-Hochschule (Ton- und Bildtechnik),

·

FH Köln (Medientechnik),

·

Folkwang-Hochschule Essen (Elektronische Komposition),

·

FH Dortmund (Kamera/Design) und

·

Hochschule für Musik Detmold (Tonmeisterausbildung)

nahmen

erfolgreich daran teil.

Das dreitägige Pilotmodell „Sommerakademie

Audiovision" Juli für max. 16 Studenten aus den medienspezifischen

Studiengängen in NRW wurde von den Hochschulen inklusive Zertifizierung

durchgeführt.

Folkwang-Hochschule Essen

(ICEM), Montag der 17. Juli 2000

Begrüßung und

Konzeptvorstellung der Akademie von Frau

Angela Wallenzus

Geschichte

der Elektronischen Musik

Gesprächskonzert

„Digitale

Klangsynthese und –verarbeitung“, Übungen und Praxis

Aktuelle

Arbeiten aus dem ICEM (Institut für Computermusik und Elektronische Medien)

Abschlußgespräch

Leitung:

Prof. Dirk Reith und Thomas Neuhaus

Hochschule für Musik

Detmold, Dienstag der 18. Juli 2000:

Aufbau

und Vernetzung des ETI

Rundgang

und Übersicht über den Studiengang des Tonmeisters

Mikrofonierungsproblematiken

am Beispiel des Flügels

Klangmanipulationen

in der Populärmusik

Tagungsleiter:

Andreas Meyer und Prof. Carlos Albrecht

Fachhochschule

Dortmund, Mittwoch der 19. Juli 2000:

Themenstellung

für Außendreh und Außentonaufnahmen

Außendreh

mit drei Kameras (hiesige Studenten) und 5

Toneinheiten

in Dortmund (Teams paarweise)

Videoschnitt

am AVID und Tondigitalisierung respektive Übertragung ins HD-System

Tonpostproduktion

am fertigen Video (simultan an zwei HD-Schnittplätzen)

Leitung:

Prof. J.U. Lensing Design/Kamera

Das

Ergebnis der Akademie wurde als Kurzfilm ins Internet gesetzt.

-

PROGRAMM

WINTERAKADEMIE 19. - 23. FEBRUAR 2001 –

Aufgrund

der guten Erfahrung aus dem Pilotprojekt der Sommerakademie „Audiovisuelle

Medien“ im Juli 2000 haben die teilnehmenden Hochschulen folgende

Themenschwerpunkte für das Winterakademieprogramm angeboten:

19.02.01 - Fachhochschule Münster (interaktive Filme)

20.02.01 - Fachhochschule

Düsseldorf (Trickfilm)

21.02.01 - Fachhochschule

Düsseldorf (DVD)

22.02.01 - Robert Schumann Hochschule (Arbeiten im Bild- und Tonbereich)

23.02.01 - Fachhochschule Düsseldorf (Quicktime, Tontechnik und

Virtuelle Realitäten)

Montag der 19.02.01 FH Münster/FB Design

Begrüßung und

Konzeptvorstellung der bisherigen Akademien von Frau Angela Wallenzus

Thema: Von Hypertext und Hyperfilm –

inaktiv oder interaktiv

Modelle und Theorien

nonlinearer Medienproduktionen

Literarische und andere

„Vor“modelle

-

Buch

-

CD und Diskette

Filmische „Vor“modelle

TV-Beispiele

Praktische Beispiele aus

dem FB Design Münster

Script und Flowchart

Dramaturgie

Interfaces und ihre

Probleme

Diskussion mit den

Gestaltern/ Autoren aus Münster

Leitung: Prof. Norbert

Nowotsch/Mediendesign

Dienstag der 20.02.01 FH Düsseldorf/Design

Thema: Trickfilm

Kurze Einführung in die

Geschichte des Trickfilms

Bewegung im Trickfilm

(Grundlagen)

Verschiedenen

Trick-Techniken (Zeichen-, Lege-, Knete-, Computertrick)

Kleine praktische

Trickfilmübung (in kleinen Gruppen) im Trickstudio

Bei den Theorie-Phasen

werden Videobeispiele oder Videodokumentationen mitverwendet

Leitung: Florian Boddin,

Dieter Fleischmann / Lehrbeauftragter für Trickfilm am Fachbereich Design an

der FH Düsseldorf

Mittwoch der 21.02.01 FH Düsseldorf/Design

Thema: DVD-Mastering

Eigenschaften/Möglichkeiten/Anwendungsgebiete der

DVD

Technische Details:

Formate, verwendete Video- und Audio-Kompressionsverfahren

Der DVD-Premastering-Prozess:

Planung, Kodierung, Programmierung, Multiplexing

Erstellung eines DVD-Videos

Leitung: Florian Boddin,

Torsten Berßelis / Lehrbeauftragter am Fachbereich Design an der FH

Donnerstag der 22.02.01 an der Robert

Schumann Hochschule Düsseldorf

Thema: Ton und Bild

Tonbereich:

"Postproduktion im Popularmusikbereich"

Liveaufnahmen einer Big

Band im Tonstudio der Hochschule